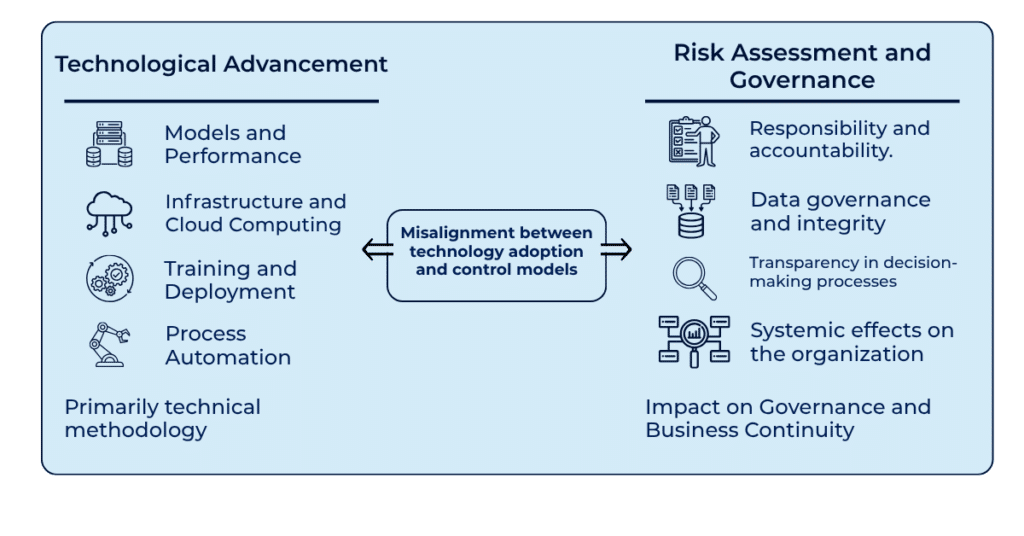

L’intelligenza artificiale sta entrando rapidamente nei processi aziendali, influenzando decisioni operative, interazioni con i clienti e modelli di business. Tuttavia, la discussione tende spesso a concentrarsi sugli aspetti tecnologici, mentre il vero cambiamento riguarda la governance. L’adozione di sistemi di AI introduce nuove questioni legate alla responsabilità, al controllo dei dati, alla trasparenza delle decisioni e alla gestione del rischio. Più che un semplice strumento tecnologico, l’AI rappresenta quindi una sfida di governo e di gestione del rischio per l’intera organizzazione.

L’intelligenza artificiale sta cambiando drasticamente il modo in cui le aziende operano. Non si tratta solo di una nuova applicazione, ma di un nuovo modo di pensare i processi decisionali, l’interazione con il cliente e l’evoluzione stessa dei modelli di business. Tuttavia, mentre il settore celebra le promesse dell’automazione e dell’efficienza algoritmica, c’è una sottile e pericolosa crepa nella narrativa predominante. Spesso la discussione si concentra esclusivamente sugli aspetti tecnologici: quali modelli sono più veloci, quale stack cloud utilizzare, come ottimizzare l’addestramento. Per chi ha il compito di garantire la sicurezza e la continuità operativa, è cruciale riconoscere che questa prospettiva è quantomeno parziale.

L’introduzione dell’AI nelle operazioni aziendali introduce un livello di complessità che va ben oltre la semplice gestione dei server o delle applicazioni legacy. Introduce nuove domande spinose sulla responsabilità legale, sul controllo profondo dei dati e sulla trasparenza dei processi decisionali. Per la sicurezza aziendale, l’AI non è uno strumento in più da integrare; è un vettore di rischio sistemico che richiede una ristrutturazione del modello di difesa.

Quando parliamo di sicurezza informatica, solitamente il nostro campo di battaglia è delimitato dal perimetro di rete, dalle infrastrutture più o meno locali, cloud e SaaS, dagli endpoint e dalle identità degli utenti. Introducendo nell’equazione la gestione sicura di dati, i contorni si fanno più sfumati e con l’AI, il perimetro diventa completamente fluido. Se consideriamo l’AI come un semplice “nuovo software da acquistare” (lo usano tutti, perché noi no?) ci esponiamo a rischi per cui rischiamo di non avere la competenza o gli strumenti necessari ad una gestione efficace.

Il problema fondamentale è che l’adozione di sistemi di AI “migra” una componente del rischio dalla parte operativa (l’infrastruttura, deterministica) a quella decisionale (il o i modelli analitici o generativi, dunque non deterministici). In un contesto tradizionale, se un malware infetta un server, possiamo isolare il sistema. In un ambiente AI, se un modello è compromesso o se i dati utilizzati per l’addestramento sono “poisoned” o “biased”, l’intero processo decisionale dell’organizzazione può essere manipolato. Non stiamo più solo proteggendo dati statici; stiamo proteggendo l’integrità dell’algoritmo stesso.

Questo porta a una questione di governance che è spesso ignorata nelle discussioni tecniche. Se l’IA prende decisioni che hanno impatti operativi, dove sta la responsabilità legale se quella decisione è errata? La governance deve definire chi è responsabile quando un algoritmo discrimina involontariamente, violando normative come il GDPR o l’AI Act europeo. La tecnologia da sola non può garantire che queste responsabilità siano soddisfatte: è necessario un framework umano e procedurale solido.

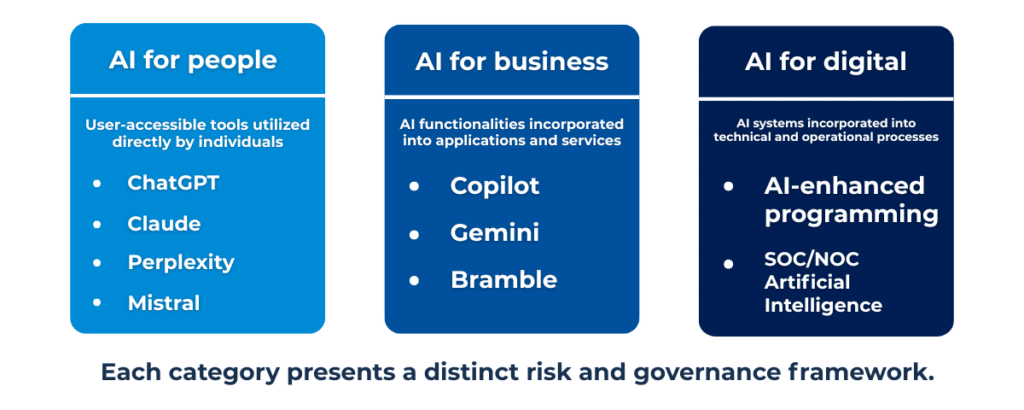

Senza voler a tutti i costi rincarare la dose, è importante definire in quali campi d’applicazione o casi d’uso l’adozione o l’impiego dell’AI è rilevante.

Strizzando l’occhio al noto modello di governance AI TRiSM di Gartner, possiamo azzardare una semplificazione che aiuta a calarlo in termini pratici e definibili tramite criteri omogenei.

La prima categoria “semplificata” è quella dell’AI generativa non specializzata, i grandi LLM commerciali e open source, che potremo definire “AI for people”, come ChatGPT, Perplexity, Mistral, LLama, ecc.. Chiunque è in grado di accedere ed utilizzare questi strumenti per ogni genere di scopo, inclusa l’analisi, elaborazione, trasformazione e sintesi di qualsiasi dato che, con ogni probabilità in un contesto business, sarà di proprietà dell’organizzazione. Questa categoria di strumenti AI presenta rischi e criticità differenti dalle categorie che vedremo a breve, e dunque necessiterà di un paradigma di governance proprio ed un’analisi del rischio dedicata.

La seconda categoria “semplificata” è quella dell’AI generativa specializzata embedded in sistemi e applicazioni che un’organizzazione ha spesso già adottati ed utilizza attivamente. Potremmo definire queste AI come “AI for business” i cui esempi più famosi sono Copilot, Gemini for Work, Rovo, ecc. Se è vero che gli utenti di un’organizzazione non possono utilizzare queste funzionalità direttamente ed indiscriminatamente (il rischio di Shadow AI è quindi meno probabile), è altrettanto palese come un’azienda potrebbe trovarsi dall’oggi al domani a vedersi attivato ad esempio un “innovativo chatbot basato su intelligenza artificiale”, che non aveva mai pensato di aver acquistato, come parte di un servizio o applicazione ben nota. Questa categoria di strumenti AI presenta rischi e criticità completamente diversi, perché da un lato il sistema o servizio di cui sono parte è solitamente censito e governato, mentre la specifica funzionalità – foriera di rischi e vulnerabilità propri – no.

Terza ed ultima categoria è “AI for digital” che abbraccia tutti gli strumenti ad alta specializzazione dedicati all’automazione, ottimizzazione, gestione e monitoraggio di un ambiente digitale complesso. Parliamo di piattaforme di AI-assisted coding, agentic AI, AI enhanced SOC e NOC come Github Copilot, DeepCode AI, Radiant, ecc. In questo ambito fortemente orientato verso le funzioni digitali tecniche dell’organizzazione il denominatore comune è la profondità e pervasività con cui questi sistemi hanno la possibilità di operare e dunque la criticità del mantenere gli umani nel “loop” diventa (quasi) questione di vita o di morte. Solo un mese fa AWS ha sofferto disservizi rilevanti a causa dell’attività di agenti AI autonomi – a detta di AWS stessa – non correttamente limitati negli accessi e nella libertà decisionale, classificando l’incidente come “human error”. Curioso come il detto “chi sbaglia, paga” si applichi con una certa transitività quando di mezzo c’è una macchina, la quale è responsabile, ma non accountable, delle proprie azioni, proprio perché quest’ultima è prerogativa esclusiva degli operatori umani.

Facile indovinare a chi squillerà il telefono quando del codice vulnerabile scritto da un coding agent, validato e testato da un’altra piattaforma AI-based andrà in produzione con esiti facilmente prevedibili.

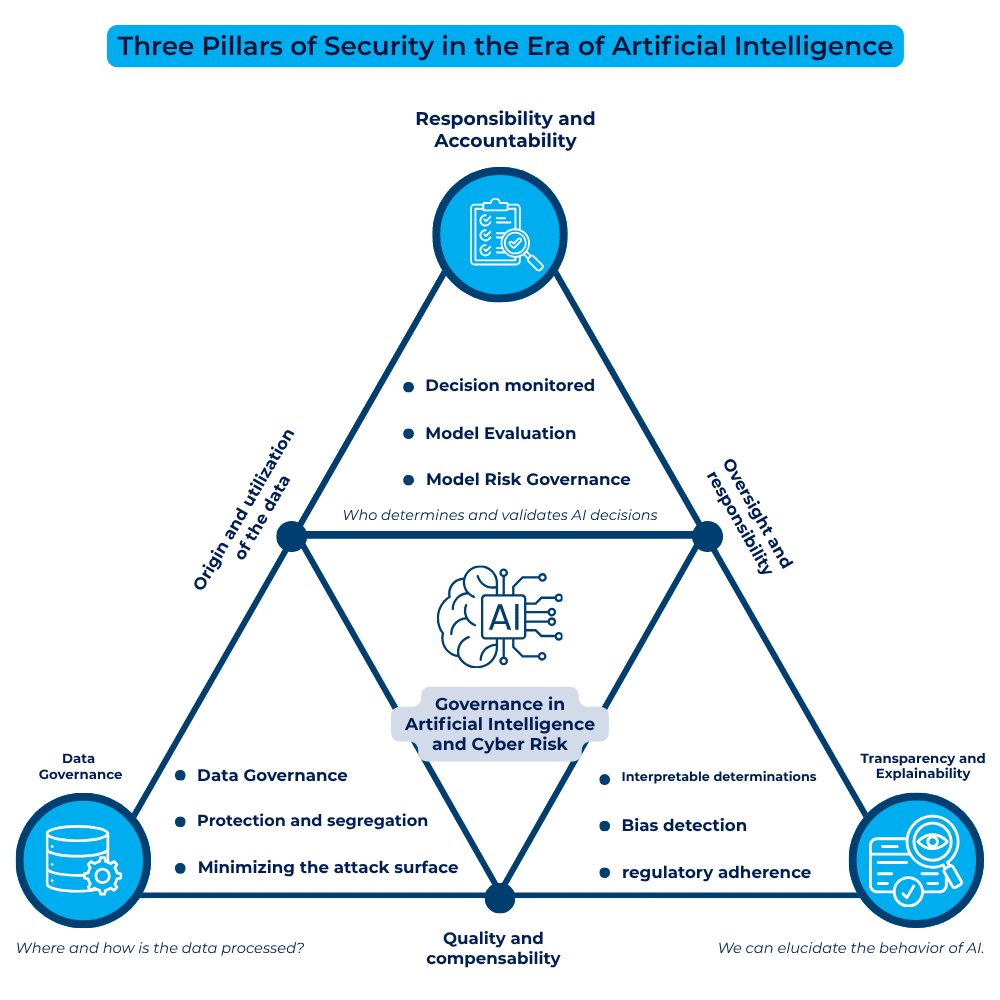

Alla luce di questi scenari, è chiaro come la strategia di sicurezza non può rimanere invariata. Dobbiamo guardare a tre aree specifiche dove la governance dell’AI incrocia direttamente la cybersecurity.

La prima area è la responsabilità e accountability. In un mondo di automazione avanzata, è essenziale avere tracciabilità completa delle decisioni. Un CISO non può delegare la responsabilità di una decisione automatizzata ad una black box. Dobbiamo garantire la possibilità di auditare il percorso decisionale: quali dati sono stati inseriti, quali parametri ha usato il modello, e chi ha supervisionato l’azione finale. Questo richiede di integrare il Model Risk Management nel tradizionale Risk Management aziendale.

La seconda area è il controllo dei dati. L’AI vive dei dati, ma la sicurezza vive della loro provenienza. Se un modello entra in contatto con dati critici senza protezioni adeguate, il rischio di data leakage o inversione dei dati (model inversion attacks) aumenta esponenzialmente. La governance dell’AI deve imporre rigide regole su dove i dati vengono elaborati, assicurando che il confine tra il cloud pubblico e le infrastrutture private sia rispettato, non solo per motivi di compliance, ma per limitare la superficie di attacco.

Infine, la trasparenza. Il concetto di “scatola nera” è inaccettabile da un punto di vista di sicurezza e di fiducia. Se non possiamo spiegare perché l’AI ha negato un servizio o approvato una transazione, non possiamo garantire la trasparenza richiesta dalle normative. Questo implica l’adozione di tecniche di Explainable AI non come opzione, ma come requisito di sicurezza, permettendo di individuare bias o manipolazioni post-deployment.

È importante comprendere che, più che un problema tecnico, l’adozione dell’AI rappresenta una sfida di governo per l’intera organizzazione. Spesso ci si aspetta che l’IT gestisca da solo queste nuove istanze, ma la vera gestione del rischio riguarda il comportamento umano e la cultura aziendale. Il compito di policy maker ed executive aziendali è trasformare l’AI da semplice tecnologia ad asset governato con integrità.

La velocità dell’innovazione deve essere bilanciata con la capacità di governare i rischi associati. Non si tratta di rallentare l’adozione, ma di assicurarsi che ogni nuovo caso d’uso passi attraverso una valutazione di rischio che includa la sicurezza dell’algoritmo, la sicurezza dei dati di input e la sicurezza del processo di output.

In sostanza, l’AI è una responsabilità che deve essere gestita con la stessa prudenza con cui gestiamo la continuità operativa o la protezione dei dati finanziari e personali.

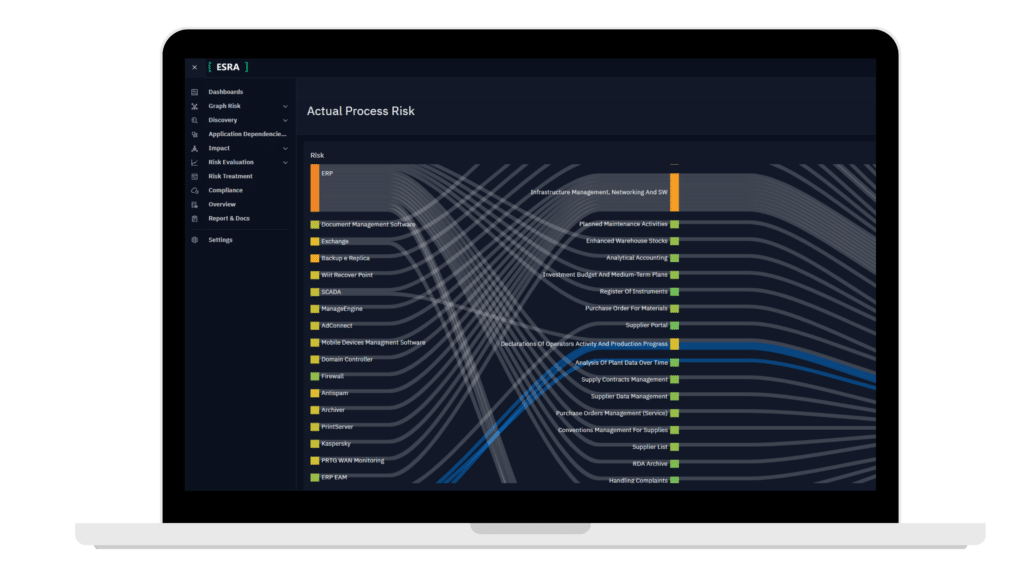

Per i security leader, è importante iniziare mappare i casi d’uso esistenti non per la loro funzione, ma per il loro rischio potenziale. Ogni modello AI in produzione deve essere considerato come un sistema informativo complesso, che rientra nel modello di risk management e nella BIA con una precisa mappatura rispetto ai margini di contribuzione sui processi aziendali. L’AI generativa richiede perciò monitoraggio continuo, test di sicurezza specifici realizzabili con strumenti dedicati, e una valutazione dei fornitori che vada oltre il semplice SLA.

In generale, nella gestione del rischio, l’adozione di nuove tecnologie introduce inevitabilmente nuove potenziali vulnerabilità, che richiedono a loro volta l’utilizzo di strumenti sempre più avanzati.

Nel caso della AI, l’impatto sul rischio è particolarmente evidente, in quanto il suo utilizzo, specie se caratterizzato da agent autonomi, introduce fattori di imprevedibilità assoluta sul funzionamento dei processi. L’introduzione degli AI agents sta facendo sì che gli approcci tradizionali di gestione del rischio risultino sempre più inefficienti.

Oggi abbiamo macchine che prendono iniziative, introducono codice, nuovi processi e rendono l’intervento umano sempre più marginale rispetto alle decisioni.

A macchine più intelligenti e più autonome devono corrispondere sistemi di gestione del rischio altrettanto intelligenti e in grado di rispondere con la medesima autonomia e rapidità.

L’adozione dell’AI introduce una discontinuità nel modo in cui il rischio si distribuisce all’interno dell’organizzazione, estendendosi ai processi e agli strumenti operativi, senza una piena visibilità di dove e come intervenga.

ai.esra costruisce e aggiorna in modo continuo il digital twin dell’organizzazione, rendendo visibili gli applicativi realmente utilizzati e intercettando le componenti AI che si innestano nei processi, così da tenere allineata la lettura del rischio rispetto alla realtà operativa ed evitare la distanza tra ciò che è governato e ciò che nel frattempo evolve sul campo.

L’obiettivo è rendere il rischio interpretabile e gestibile anche quando i sistemi diventano più autonomi e le loro decisioni sempre meno prevedibili. Da qui in avanti, farà la differenza la capacità di governare questa complessità in modo efficace e con continuità.

ai.esra SpA – strada del Lionetto 6 Torino, Italia, 10146

Tel +39 011 234 4611

CAP. SOC. € 50.000,00 i.v. – REA TO1339590 CF e PI 13107650015

“Questo sito si impegna a garantire l’accessibilità digitale secondo la normativa europea (EAA). Per segnalare problemi di accessibilità, scrivi a: ai.esra@ai-esra.com”

ai.esra SpA – strada del Lionetto 6 Torino, Italy, 10146

Tel +39 011 234 4611

CAP. SOC. € 50.000,00 i.v. – REA TO1339590

CF e PI 13107650015

© 2024 Esra – Tutti i diritti riservati